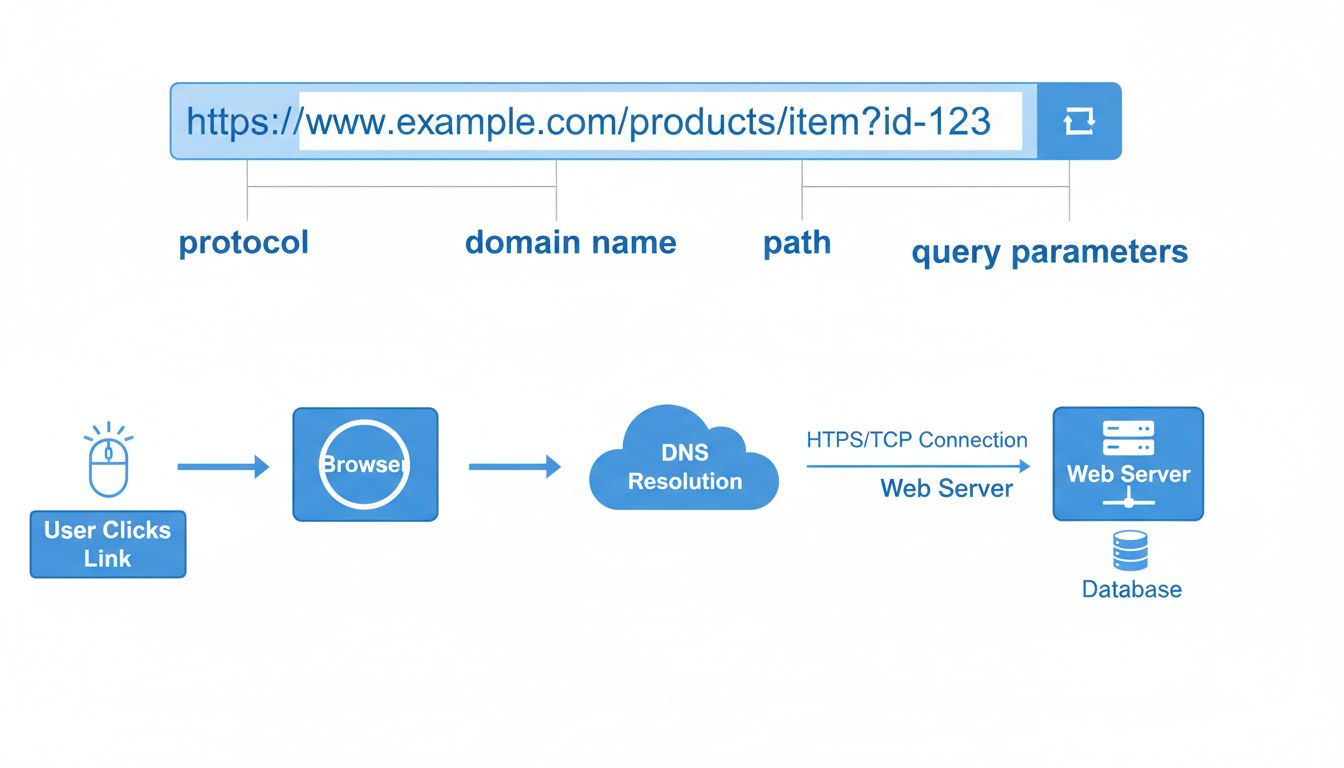

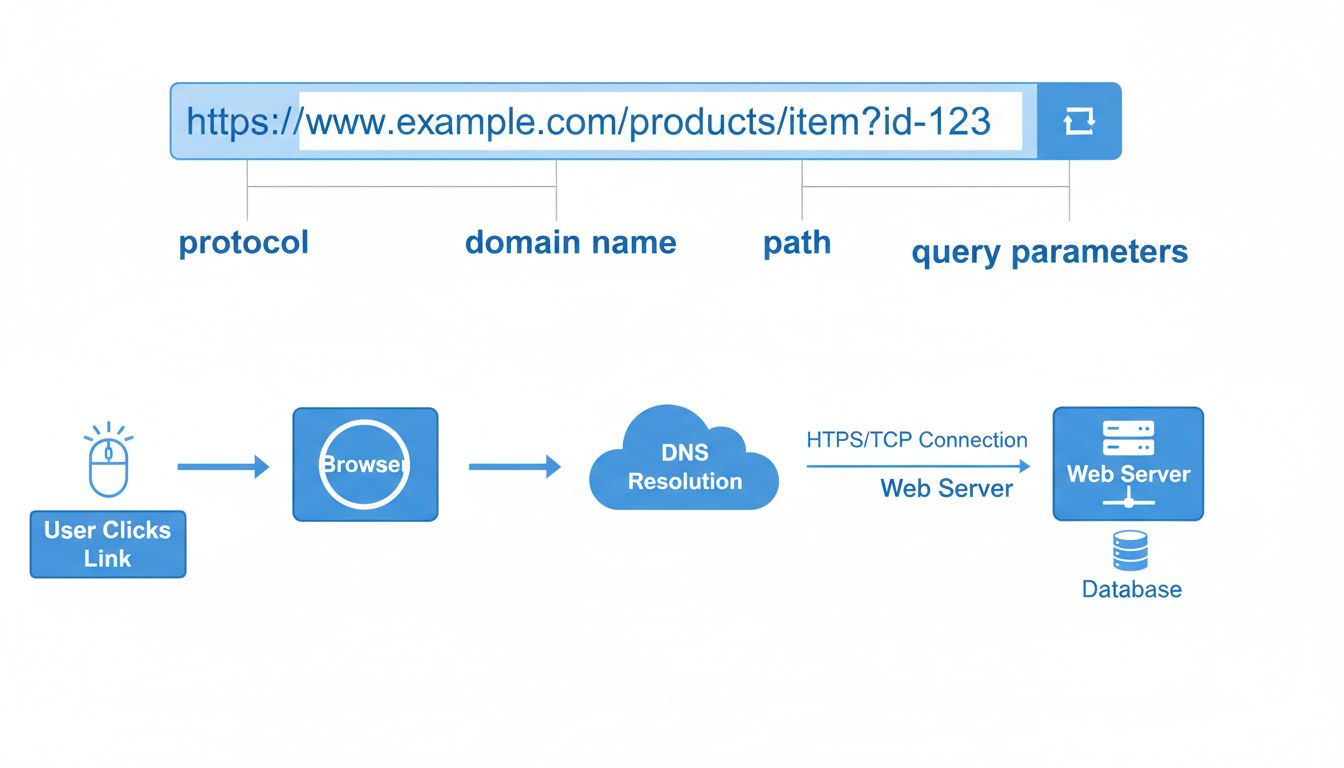

Wie funktionieren Webseiten-Links? Vollständiger Leitfaden zu URLs & Webnavigation

Erfahren Sie, wie Webseiten-Links funktionieren, verstehen Sie den Aufbau von URLs, DNS-Auflösung und den technischen Ablauf der Webnavigation. Expertenleitfade...

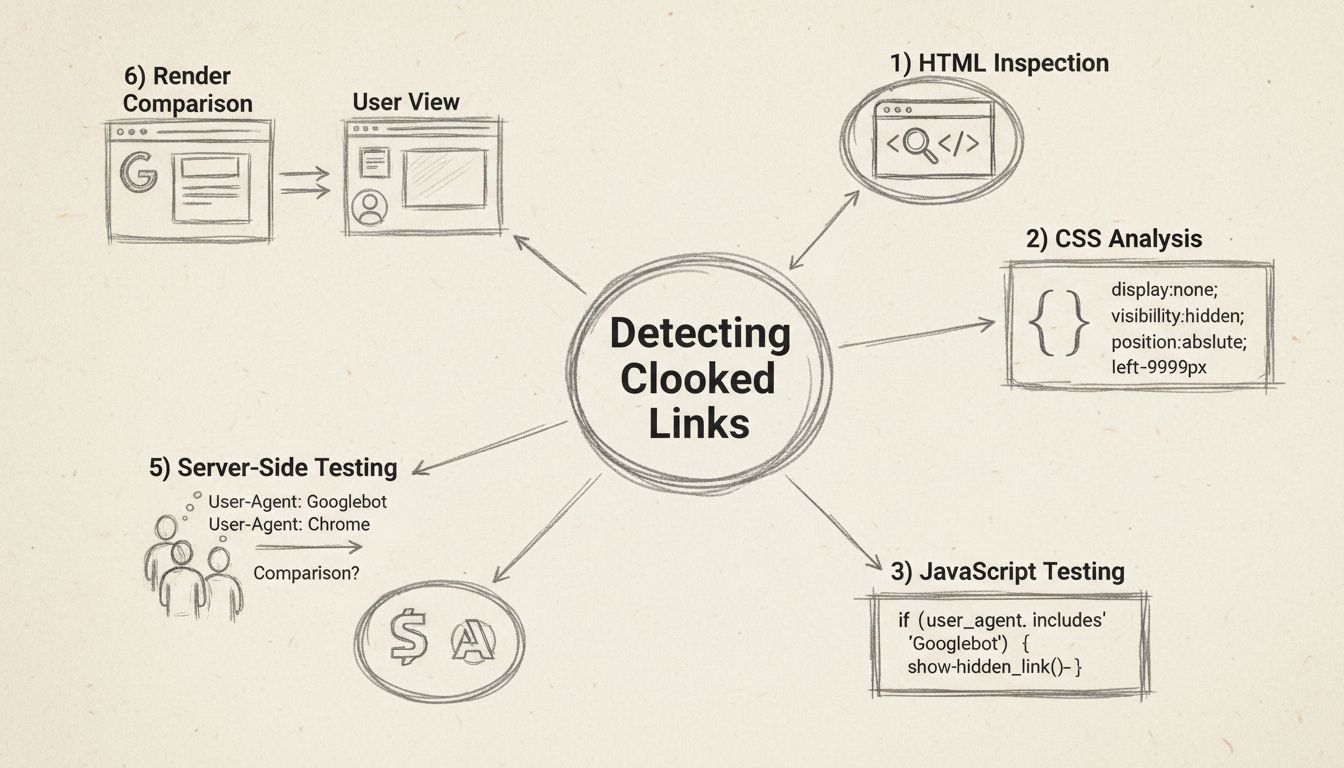

Erfahren Sie bewährte Methoden zur Erkennung von getarnten Links, einschließlich HTML-Inspektion, CSS-Analyse, JavaScript-Tests und SEO-Tools. Umfassender Leitfaden zum Auffinden versteckter Links auf Websites.

Sie können getarnte Links finden, indem Sie den Website-Quellcode prüfen, die Entwickler-Tools im Browser nutzen, um versteckte CSS-Eigenschaften zu inspizieren, JavaScript deaktivieren, um versteckte Inhalte sichtbar zu machen, vergleichen, wie Google Seiten rendert im Vergleich zur Nutzeransicht, Tests mit verschiedenen User-Agents durchführen und professionelle SEO-Tools wie Semrush, Ahrefs und Screaming Frog verwenden, die versteckte oder verschleierte Links erkennen.

Getarnte Links sind URLs, die ihr eigentliches Ziel oder ihren Inhalt vor Nutzern verbergen, während sie Suchmaschinen oder anderen Besuchern möglicherweise andere Informationen zeigen. Das Auffinden und Identifizieren getarnter Links ist essenziell für die Sicherheit Ihrer Website, die Einhaltung von SEO-Richtlinien und den Schutz Ihres Affiliate-Programms vor betrügerischen Praktiken. Ob Sie nun Ihre eigene Website prüfen, verdächtige Aktivitäten untersuchen oder die Einhaltung der Suchmaschinenrichtlinien sicherstellen möchten – das Verstehen der Erkennung getarnter Links ist 2025 eine wichtige Fähigkeit.

Der grundlegendste Ansatz zum Auffinden getarnter Links besteht darin, den rohen HTML-Quellcode einer Webseite zu untersuchen. Beim Anzeigen des Seitenquelltexts sehen Sie den tatsächlichen Code, den der Server an Ihren Browser sendet, was oft versteckte Elemente offenbart, die auf der gerenderten Seite nicht sichtbar sind. Diese Methode ist besonders effektiv, da getarnte Links irgendwo in der HTML-Struktur existieren müssen, selbst wenn sie durch CSS oder JavaScript-Styling verborgen werden.

Um den HTML-Quelltext zu inspizieren, klicken Sie mit der rechten Maustaste auf eine beliebige Webseite und wählen Sie „Seitenquelltext anzeigen“ oder drücken Sie Strg+U (Windows) bzw. Cmd+U (Mac). Dadurch wird der rohe HTML-Code in einem neuen Tab geöffnet, in dem Sie nach verdächtigen Mustern suchen können. Achten Sie auf Anker-Tags (<a>-Elemente) mit href-Attributen, die auf unerwartete Ziele verweisen. Viele getarnte Links werden mit Inline-Styles oder CSS-Klassen versteckt, die Eigenschaften zur Unsichtbarmachung anwenden. Suchen Sie nach gängigen Mustern wie display:none, visibility:hidden, opacity:0 oder position:absolute in Kombination mit extremen negativen Koordinaten wie left:-9999px.

Browser-Entwicklertools bieten noch leistungsfähigere Inspektionsmöglichkeiten. Drücken Sie F12, um die Entwicklertools zu öffnen, und verwenden Sie dann den Tab „Elemente“ oder „Inspektor“, um einzelne Elemente auf der Seite zu untersuchen. Sie können über Elemente fahren, um deren berechnete Styles zu sehen, was aufzeigt, ob CSS-Eigenschaften Inhalte verbergen. Die DevTools zeigen Ihnen auch die DOM-Baumstruktur, sodass Sie alle Elemente sehen, auch solche, die durch CSS-Manipulation nicht visuell gerendert werden. Dies ist besonders nützlich, um Links zu identifizieren, die zwar im HTML vorhanden, aber für Nutzer vollständig unsichtbar sind.

CSS-Tarnung ist eine der häufigsten Techniken, um Links vor Nutzern zu verbergen, während sie für Suchmaschinen zugänglich bleiben. Das Verständnis der spezifischen CSS-Eigenschaften, die zur Tarnung eingesetzt werden, hilft, verdächtige Muster schnell zu erkennen. Zu den geläufigsten CSS-Tarnungsmethoden gehören weißer Text auf weißem Hintergrund, Positionierung außerhalb des sichtbaren Bereichs, Null-Dimensionen und Manipulation der Deckkraft.

Weiße Schrift auf weißem Hintergrund bedeutet, dass die Textfarbe der Hintergrundfarbe angepasst wird, sodass der Inhalt für Nutzer unsichtbar, aber im HTML vorhanden bleibt. Sie können dies erkennen, indem Sie den gesamten Text auf der Seite markieren (Strg+A) und prüfen, ob Text sichtbar wird, der vorher verborgen war. Die Positionierung außerhalb des Bildschirms nutzt CSS-Eigenschaften wie position: absolute; left: -9999px;, um Inhalte weit außerhalb des sichtbaren Bereichs zu verschieben. Null-Dimensionen setzen width: 0; height: 0; oder font-size: 0;, sodass Elemente auf unsichtbare Größen reduziert werden. Die Manipulation der Deckkraft erfolgt mit opacity: 0;, wodurch Elemente vollständig durchsichtig bleiben, aber im DOM erhalten bleiben.

Um diese Techniken systematisch zu erkennen, nutzen Sie die DevTools Ihres Browsers, inspizieren Sie verdächtige Elemente und überprüfen Sie deren berechnete Styles. Suchen Sie nach Kombinationen aus Positionierungs-, Größen- oder Farbeigenschaften, die Inhalte unsichtbar machen würden. Viele seriöse Websites wenden ähnliche Techniken für Barrierefreiheit an (z. B. versteckte „Skip-to-Content“-Links) – der Kontext ist also entscheidend. Werden diese Methoden jedoch mit keywordlastigem Text oder Links zu nicht verwandten Domains kombiniert, deutet dies auf Tarnung hin. Die transparente Linkverwaltung von PostAffiliatePro stellt sicher, dass alle Ihre Affiliate-Links legitim und konform mit Suchmaschinenrichtlinien sind und verzichtet vollständig auf solche irreführenden Methoden.

JavaScript-basierte Tarnung wird immer ausgefeilter, da Links oder Inhalte dynamisch nach dem Laden der Seite eingebunden werden können. Diese Art der Tarnung ist besonders schwer zu erkennen, da die versteckten Inhalte im initialen HTML-Quellcode nicht erscheinen. Um JavaScript-basierte Tarnung zu identifizieren, müssen Sie vergleichen, wie die Seite mit aktiviertem und deaktiviertem JavaScript aussieht.

Deaktivieren Sie JavaScript in Ihren Browsereinstellungen und laden Sie die Seite neu, um zu sehen, welche Inhalte durch JavaScript verborgen werden. In den meisten Browsern können Sie JavaScript über die Entwicklereinstellungen oder Erweiterungen deaktivieren. Erscheinen bedeutende Inhalte oder Links, die vorher nicht sichtbar waren, ist das ein Hinweis auf JavaScript-Tarnung. Untersuchen Sie zudem den JavaScript-Code selbst im Tab „Quellen“ der DevTools. Suchen Sie nach Code, der den User-Agent erkennt (das ist der Bezeichner, der Websites mitteilt, welcher Browser oder Bot zugreift) und daraufhin unterschiedliche Inhalte ausliefert.

Typische JavaScript-Tarnungsmuster umfassen das Prüfen auf Googlebot-User-Agents und das Ausliefern unterschiedlicher Inhalte für Suchmaschinen, das Erkennen von mobilen versus Desktop-Browsern und das Anzeigen unterschiedlicher Seiten oder das Verwenden der Referrer-Erkennung, um je nach Herkunft unterschiedliche Inhalte zu zeigen. Suchen Sie im Quellcode nach verdächtigen JavaScript-Mustern wie navigator.userAgent, User-Agent oder Bedingungen, die auf Bot-Bezeichner prüfen. Der Netzwerk-Tab der DevTools zeigt zudem alle Anfragen der Seite und deckt auf, ob zusätzliche Ressourcen bedingt nach User-Agent oder anderen Faktoren geladen werden.

Eine der effektivsten Methoden zur Tarnungserkennung ist der Vergleich, wie eine Seite für Nutzer und wie sie für Suchmaschinen erscheint. Google stellt dafür offizielle Tools bereit, die Diskrepanzen leicht aufzeigen. Das URL-Prüftool der Google Search Console zeigt exakt, wie Googlebot eine bestimmte URL rendert und indexiert, sodass Sie dies mit der normalen Nutzeransicht vergleichen können.

Verwenden Sie dazu die Google Search Console, gehen Sie zum URL-Prüftool und geben Sie die zu prüfende URL ein. Google zeigt Ihnen das gerenderte HTML, das Googlebot sieht – inklusive aller durch JavaScript erzeugten Inhalte. Vergleichen Sie dies mit Ihrer normalen Seitenansicht. Zeigt die gerenderte Version andere Inhalte, Links oder Metadaten als die Nutzersicht, deutet das auf Tarnung hin. Achten Sie insbesondere auf Unterschiede bei Seitentiteln, Meta-Beschreibungen, Überschriften und der Zahl der vorhandenen Links.

Der Google Rich Results Test liefert eine weitere Perspektive und zeigt, wie Googles strukturierter Datenparser Ihre Seite interpretiert. Das hilft bei der Erkennung von Tarnung im Bereich Schema-Markup oder strukturierter Daten. Außerdem können Sie die Browser-DevTools nutzen, um das initiale HTML („Seitenquelltext anzeigen“) mit dem finalen DOM nach JavaScript-Ausführung (Tab „Elemente“) zu vergleichen. Klicken Sie mit der rechten Maustaste und wählen Sie „Seitenquelltext anzeigen“, dann öffnen Sie die DevTools und inspizieren Sie den Tab „Elemente“, um den endgültigen Zustand zu sehen. Bedeutende Unterschiede zwischen diesen Ansichten deuten auf JavaScript-Injektion oder Tarnung hin.

Serverseitige Tarnung bedeutet, dass der Webserver selbst je nach Eigenschaften der Anfrage, insbesondere dem User-Agent-Header, unterschiedliche Inhalte ausliefert. Dies ist eine der hinterhältigsten Tarnungstechniken, da sie vor dem Empfang im Browser stattfindet. Um serverseitige Tarnung zu erkennen, müssen Sie dieselbe URL mit verschiedenen User-Agents anfragen und die Antworten vergleichen.

Verwenden Sie Kommandozeilentools wie cURL oder Postman, um verschiedene User-Agents zu testen. Beispielsweise können Sie eine Anfrage mit einem regulären Browser-User-Agent und einen mit dem Googlebot-User-Agent ausführen. Die Befehle lauten:

curl -H "User-Agent: Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com

curl -H "User-Agent: Mozilla/5.0 (compatible; Googlebot/2.1)" https://example.com

Vergleichen Sie die Antwortgrößen, Inhalte, HTTP-Statuscodes und Metadaten dieser Anfragen. Unterscheiden sich die Antworten signifikant, liefert der Server wahrscheinlich unterschiedliche Inhalte basierend auf dem User-Agent – eine Form der Tarnung. Prüfen Sie außerdem auf versteckte Weiterleitungen, die nur für bestimmte User-Agents auftreten. Manche Seiten leiten mobile Nutzer auf Spam-Domains weiter, während Desktop-Nutzern legitime Inhalte präsentiert werden, oder leiten Suchmaschinenbenutzer zu legitimen Inhalten und reguläre Benutzer woanders hin.

Analysieren Sie Ihre Server-Logs auf Muster, die zeigen, dass unterschiedlichen User-Agents unterschiedliche Inhalte geliefert werden. Achten Sie auf Anfragen von Googlebot, die andere Antworten erhalten als identische Anfragen von normalen Browsern. Überprüfen Sie, ob Anfragen, die angeblich von Googlebot stammen, tatsächlich aus Googles IP-Bereichen kommen, z. B. durch Reverse-DNS-Lookup. Verlassen Sie sich nicht nur auf den User-Agent-Header, da dieser leicht gefälscht werden kann. Vergleichen Sie die Quell-IP-Adresse mit Googles veröffentlichten IP-Bereichen, um legitime Googlebot-Anfragen zu bestätigen.

| Tool-Name | Typ | Hauptfunktion | Beste Anwendung |

|---|---|---|---|

| Google Search Console | Offiziell | URL-Prüfung & Render-Analyse | Vergleich Google-Ansicht vs. Nutzeransicht |

| Google Rich Results Test | Offiziell | Validierung strukturierter Daten | Erkennung getarnter Schema-Markups |

| Screaming Frog SEO Spider | Drittanbieter | HTML-Crawling & Vergleich | Vergleich gerendertes vs. Quell-HTML |

| Semrush Site Audit | Drittanbieter | Inhaltsanalyse & Tarnungserkennung | Auffinden versteckter Inhaltsmuster |

| Ahrefs Site Audit | Drittanbieter | Analyse von Inhaltsabweichungen | Auffinden von Inhaltsunterschieden |

| Browser DevTools | Integriert | HTML/CSS/JavaScript-Inspektion | Manuelle Element-Inspektion |

| cURL/Postman | Kommandozeile | User-Agent-Tests | Serverseitige Tarnungserkennung |

| Lighthouse | Integriert | Qualitätsprüfung der Seite | Rendering- und Performance-Probleme |

Professionelle SEO-Tools wie Semrush und Ahrefs verfügen über integrierte Tarnungserkennungsfunktionen, die Ihre Website automatisch scannen und Inhalte vergleichen, die an verschiedene User-Agents ausgeliefert werden. Der Screaming Frog SEO Spider eignet sich besonders zum Crawlen ganzer Websites und zum Vergleich des gerenderten HTML mit dem Quell-HTML, wodurch sich Abweichungen auf Hunderten von Seiten leicht erkennen lassen. Diese Tools sparen im Vergleich zur manuellen Prüfung viel Zeit und entdecken Tarnungsprobleme, die Sie mit einfachen Inspektionsmethoden möglicherweise übersehen.

Den Unterschied zwischen legitimer Linkverwaltung und Tarnung zu verstehen, ist entscheidend für die Einhaltung der Suchmaschinenrichtlinien. Zu den legitimen Praktiken zählen der Einsatz von JavaScript zur Darstellung von Inhalten, die für Nutzer und Suchmaschinen sichtbar sind, serverseitiges Rendering, das allen Besuchern identische Inhalte bietet, Responsive Design, das Inhalte für verschiedene Geräte zwar unterschiedlich darstellt, aber immer dieselben Informationen zeigt, und Paywalls, bei denen Suchmaschinen wie autorisierte Nutzer die vollständigen Inhalte sehen können.

Irreführende Praktiken, die als Tarnung gelten, umfassen das Anzeigen unterschiedlicher URLs oder Inhalte abhängig vom User-Agent, das Ausliefern von keywordlastigen Inhalten ausschließlich an Suchmaschinen, das Weiterleiten von Suchmaschinenbenutzern auf andere Seiten als normale Nutzer und das gezielte Verstecken von Inhalten mit CSS oder JavaScript, um Suchmaschinen zu täuschen. Googles Spam-Richtlinien verbieten Tarnung ausdrücklich und können zu manuellen Maßnahmen, Rankingabstrafungen oder vollständigem Ausschluss aus den Suchergebnissen führen. PostAffiliatePro zeichnet sich als führende Affiliate-Software aus, da sie eine transparente, legale Linkverwaltung ohne jegliche Tarnung oder Irreführung bietet und somit Ihr Affiliate-Programm konform und vertrauenswürdig bleibt.

Setzen Sie einen systematischen Workflow zur Erkennung getarnter Links um, indem Sie folgende Schritte befolgen: Führen Sie zunächst eine erste Inspektion durch, indem Sie den Seitenquelltext anzeigen, Browser-DevTools zur Elementinspektion nutzen und versteckte CSS-Eigenschaften überprüfen. Zweitens vergleichen Sie das Rendering, indem Sie das Google-URL-Prüftool verwenden, gerendertes HTML mit Quell-HTML vergleichen und auf Inhaltsunterschiede achten. Drittens testen Sie JavaScript, indem Sie JavaScript deaktivieren und die Seite neu laden, in der DevTools-Konsole nach Bot-Erkennungscode suchen und sichtbare Inhalte mit und ohne aktiviertes JavaScript vergleichen.

Viertens führen Sie User-Agent-Tests durch, indem Sie mit cURL oder Postman verschiedene User-Agents testen, Antwortgrößen und Inhalte vergleichen und auf bedingte Weiterleitungen prüfen. Fünftens analysieren Sie Serverprotokolle, indem Sie Muster für unterschiedliche Auslieferungen an verschiedene User-Agents prüfen, auf verdächtige IP-Adressen achten und schnelle Anfragen von botartigen User-Agents beobachten. Schließlich nutzen Sie automatisiertes Scannen mit professionellen SEO-Tools wie Semrush, Ahrefs oder Screaming Frog, um versteckte Inhalte auf Ihrer gesamten Website zu erkennen. Dieser umfassende Ansatz stellt sicher, dass Sie sowohl offensichtliche als auch ausgeklügelte Tarnungsversuche entdecken.

Regelmäßige Überwachung ist 2025 unverzichtbar, da sich Tarnungstechniken ständig weiterentwickeln. Führen Sie vierteljährliche Audits Ihrer Website und Affiliate-Links durch, um die fortlaufende Einhaltung sicherzustellen. Richten Sie in der Google Search Console Benachrichtigungen ein, die Sie über manuelle Maßnahmen oder Indexierungsprobleme informieren, die auf Tarnungsprobleme hinweisen könnten. Nutzen Sie die integrierten Compliance-Funktionen von PostAffiliatePro, um sicherzustellen, dass alle Ihre Affiliate-Links transparent und legitim sind – zum Schutz des Rufs Ihres Programms und Ihrer Suchmaschinenrankings.

PostAffiliatePro bietet transparente, legale Linkverwaltung und -verfolgung ohne Tarnung oder irreführende Methoden. Verwalten Sie Ihr Affiliate-Programm mit vollständiger Transparenz und Compliance.

Erfahren Sie, wie Webseiten-Links funktionieren, verstehen Sie den Aufbau von URLs, DNS-Auflösung und den technischen Ablauf der Webnavigation. Expertenleitfade...

Entdecken Sie, warum eingehende Links für den SEO-Erfolg entscheidend sind. Erfahren Sie, wie Backlinks das Ranking verbessern, Traffic steigern, Autorität aufb...

Erfahren Sie die optimale Häufigkeit für die Überprüfung ausgehender Links im Jahr 2025. Entdecken Sie vierteljährliche, monatliche und jährliche Überprüfungspl...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.