Sind Shadow Domains gut? Risiken, Erkennung & Präventionsleitfaden

Erfahren Sie, warum Shadow Domains schädliche Black-Hat-SEO-Taktiken sind. Informieren Sie sich über Risiken wie Suchmaschinenstrafen, Traffic-Umleitung, Marken...

Erfahren Sie, warum Shadow Pages Ihrer SEO schaden, wie sie das Crawl-Budget verschwenden, Duplicate Content-Probleme verursachen, und entdecken Sie bewährte Strategien, um sie von Ihrer Website zu entfernen.

Ja, Shadow Pages sind im Allgemeinen schlecht für SEO. Sie verschwenden das Crawl-Budget, verursachen Duplicate-Content-Probleme, verwässern Link Equity und wirken sich negativ auf die Nutzererfahrung aus. Suchmaschinen können Websites mit übermäßigen Shadow Pages abstrafen, was zu niedrigeren Rankings und geringerer organischer Sichtbarkeit führt.

Shadow Pages, auch als Ghost Pages bekannt, sind Webseiten, die auf Ihrer Website existieren, aber für Nutzer verborgen bleiben und oft von Suchmaschinen nicht indexiert werden. Diese Seiten entstehen typischerweise unbeabsichtigt durch eine schlechte Seitenarchitektur, dynamisch generierte Inhalte ohne ordnungsgemäße Verlinkung oder unzureichendes Redirect-Management. Im Gegensatz zu absichtlich versteckten Seiten, die bestimmte Zwecke erfüllen, stellen Shadow Pages ein strukturelles Problem dar, das Suchmaschinen vor Herausforderungen bei der Kategorisierung und Indexierung stellt. Das grundlegende Problem besteht darin, dass diese Seiten wertvolle Ressourcen verbrauchen, ohne einen sinnvollen Beitrag zur SEO-Leistung oder Nutzererfahrung Ihrer Website zu leisten.

Das Vorhandensein von Shadow Pages löst eine Kettenreaktion von Problemen aus, die sich mit der Zeit verstärken. Wenn Suchmaschinen-Crawler auf diese Seiten stoßen, müssen sie entscheiden, ob sie gecrawlt und indexiert werden sollen, was die Aufmerksamkeit von wichtigeren Inhalten ablenkt. Diese Ineffizienz wird zunehmend problematischer, je größer Ihre Website wird, da Suchmaschinen jedem Domain ein begrenztes Crawl-Budget zuweisen. Jede Sekunde, die für das Crawlen von Shadow Pages aufgewendet wird, fehlt beim Crawlen von Seiten, die tatsächlich für Ihre Geschäftsziele und Nutzerbindung relevant sind.

Suchmaschinen wie Google weisen jeder Website ein bestimmtes Crawl-Budget zu, das sich nach Autorität, Größe und Aktualisierungshäufigkeit richtet. Dieses Budget entspricht der maximalen Anzahl von Seiten, die Googlebot in einem bestimmten Zeitraum crawlen wird. Wenn Shadow Pages einen Teil dieses begrenzten Budgets verbrauchen, werden weniger wichtige Seiten rechtzeitig gecrawlt und indexiert. Für große Websites mit Tausenden von Seiten wird dies zu einem kritischen Problem, das sich direkt darauf auswirkt, wie schnell neuer Content gefunden und gerankt wird.

Das Crawl-Budget-Problem verschärft sich besonders, wenn Shadow Pages dynamisch mit Session-IDs, Tracking-Parametern oder anderen URL-Variationen erzeugt werden. Jede Variation erscheint für Suchmaschinen als eigene Seite und vervielfacht die Verschwendung des Crawl-Budgets exponentiell. Eine einzige Produktseite mit mehreren Parameterkombinationen kann Dutzende von Shadow Pages generieren, die allesamt Crawl-Budget verbrauchen, das eigentlich für geschäftskritische Inhalte genutzt werden sollte. Diese Ineffizienz führt dazu, dass Ihre Blogposts, Produktseiten und Leistungsbeschreibungen Wochen oder Monate benötigen, um vollständig indexiert zu werden, anstatt nur wenige Tage.

Shadow Pages enthalten häufig identische oder nahezu identische Inhalte zu bereits indexierten Seiten Ihrer Website. Wenn Suchmaschinen auf mehrere Versionen desselben Inhalts stoßen, stehen sie vor der Frage: Welche Version soll für das Ziel-Keyword ranken? Diese Unsicherheit führt zu Keyword-Kannibalisierung, bei der Ihre eigenen Seiten miteinander um die Rankings konkurrieren. Anstatt die Ranking-Power auf eine einzelne, autoritative Seite zu konzentrieren, wird Ihr SEO-Wert auf mehrere Seiten verteilt, was zu einer schwächeren Gesamtleistung führt.

Das Duplicate-Content-Problem geht über reine Ranking-Verwirrung hinaus. Die Algorithmen von Google sind darauf ausgelegt, Websites zu identifizieren und abzustrafen, die scheinbar absichtlich Duplicate Content zu Manipulationszwecken erstellen. Auch wenn Shadow Pages meist unbeabsichtigt entstehen, kann Google nicht immer zwischen versehentlichen Duplikaten und absichtlichem Spam unterscheiden. Das bedeutet, dass Ihre Site manuelle oder algorithmische Abstrafungen riskieren kann, was Ihre Sichtbarkeit in allen Suchergebnissen deutlich reduzieren würde – nicht nur für die duplizierten Seiten.

Backlinks zählen zu den wichtigsten Rankingfaktoren im Google-Algorithmus und stellen eine Art Vertrauensbeweis anderer Websites dar. Wenn Shadow Pages Backlinks erhalten – sei es durch interne Verlinkung oder externe Referenzen – verteilt sich das Link Equity auf mehrere Seiten, anstatt sich auf Ihre Hauptinhalte zu konzentrieren. Diese Verwässerung schwächt die Autorität Ihrer wichtigsten Seiten und mindert deren Ranking-Chancen für wettbewerbsstarke Keywords.

Internes Linking wird mit Shadow Pages besonders problematisch. Wenn Ihre Seitenarchitektur mehrere URLs für denselben Inhalt erzeugt und einige dieser URLs interne Links erhalten, andere jedoch nicht, wird Ihr Link Equity aufgeteilt. Eine Seite, die eigentlich zehn interne Links erhalten sollte, bekommt vielleicht nur fünf, während die Shadow-Page-Version die anderen fünf erhält. Diese Fragmentierung verhindert, dass eine einzelne Seite genügend Autorität aufbaut, um für wertvolle Keywords effektiv zu ranken.

Zu verstehen, wie Shadow Pages entstehen, ist entscheidend, um sie zu vermeiden. Dynamische URL-Parameter gehören zu den häufigsten Ursachen, insbesondere wenn Session-IDs, Tracking-Codes oder Benutzereinstellungen einzigartige URLs für den gleichen Inhalt generieren. E-Commerce-Websites kämpfen oft mit diesem Problem, wenn Produktfilter, Sortieroptionen oder Ansichtseinstellungen neue URLs erzeugen. Content-Management-Systeme generieren manchmal Shadow Pages durch Paginierungsparameter, druckoptimierte Versionen oder mobile URLs, die nicht ordnungsgemäß mit Canonical-Tags zusammengeführt werden.

Fehlerhafte Redirect-Implementierung erzeugt ebenfalls Shadow Pages. Beim Migrieren von Inhalten, Ändern von URL-Strukturen oder Zusammenführen von Seiten sollten alte URLs per 301-Redirect auf neue weitergeleitet werden. Erfolgt dies nicht korrekt, können Suchmaschinen sowohl alte als auch neue URLs indexieren, was zu Duplicate Content führt. Ähnlich verhält es sich, wenn Webseiten keine korrekten HTTPS-Redirects einrichten oder www- und non-www-Versionen nicht konsolidieren – auch dadurch entstehen mehrere Shadow Pages, die um Rankings konkurrieren.

Canonical-Tags zeigen Suchmaschinen, welche Version einer Seite als maßgeblich betrachtet werden soll, wenn mehrere URLs identische oder ähnliche Inhalte enthalten. Durch das Hinzufügen eines rel=“canonical”-Tags auf Shadow Pages bündeln Sie die Ranking-Signale und verhindern, dass Suchmaschinen Crawl-Budget für doppelte Versionen verschwenden. Das Canonical-Tag sollte immer auf die Hauptversion der Seite verweisen, die in den Suchergebnissen ranken soll.

Eine korrekte Canonical-Implementierung erfordert sorgfältige Planung. Bei E-Commerce-Seiten mit Produktfiltern sollte das Canonical-Tag auf gefilterten Ergebnissen auf die Basis-Produktseite zeigen. Für paginierte Inhalte sollte jede Seite ein selbstreferenzielles Canonical-Tag besitzen, alternativ können rel=“next” und rel=“prev” verwendet werden, um die Beziehung zwischen den Seiten anzugeben. Wichtig ist, dass jede Shadow Page eindeutig angibt, welche Seite das Ranking-Credit erhalten soll.

Das Noindex-Meta-Tag verhindert, dass Suchmaschinen bestimmte Seiten indexieren, während sie weiterhin gecrawlt und für Nutzer zugänglich bleiben. Dieser Ansatz eignet sich gut für Seiten, die interne Zwecke erfüllen, aber nicht in den Suchergebnissen erscheinen sollen, wie Dankeseiten, Login-Seiten oder interne Suchergebnisse. Indem Sie Shadow Pages, die keinen Mehrwert für Suchende bieten, mit Noindex versehen, verhindern Sie, dass sie Crawl-Budget verbrauchen und mit Ihren Hauptinhalten konkurrieren.

Die Implementierung von Noindex erfordert Sorgfalt, damit nicht versehentlich wichtige Seiten blockiert werden. Führen Sie eine umfassende Prüfung Ihrer Website durch, um Seiten zu identifizieren, die tatsächlich nicht indexiert werden müssen. Typische Kandidaten sind Duplicate-Content-Seiten, Seiten mit dünnem Inhalt sowie rein interne Navigations- oder Trackingseiten. Nach der Identifizierung fügen Sie das Noindex-Tag hinzu und überwachen Sie die Google Search Console, um sicherzustellen, dass diese Seiten nicht mehr in den Suchergebnissen erscheinen.

Die langfristig effektivste Lösung besteht darin, Ihre Seitenarchitektur so zu restrukturieren, dass die Entstehung von Shadow Pages verhindert wird. Das bedeutet, doppelte Inhalte auf einzelne, autoritative Seiten zu konsolidieren, ordentliche URL-Strukturen zu implementieren, die keine unnötigen Variationen erzeugen, und sicherzustellen, dass alle wichtigen Seiten über die Navigation und Inhalte Ihrer Website verlinkt sind.

Für dynamische Inhalte setzen Sie URL-Rewriting ein, um saubere, statisch wirkende URLs zu erzeugen, die keine Session-IDs oder Tracking-Parameter enthalten. Verwenden Sie auf Ihrer Website konsistente URL-Strukturen und stellen Sie sicher, dass alle Varianten einer Seite (mobil, Desktop, druckoptimiert) die gleiche URL verwenden – entweder mit Responsive Design oder Content Negotiation – statt separater URLs. Dieser Ansatz beseitigt nicht nur Shadow Pages, sondern verbessert auch die Nutzererfahrung und erleichtert Suchmaschinen das Crawlen und Indexieren.

| Tool | Zweck | Zentrale Funktionen |

|---|---|---|

| Google Search Console | Offizielles Indexierungsmonitoring | Zeigt indexierte vs. ausgeschlossene Seiten, Crawling-Fehler, Abdeckungsprobleme |

| Screaming Frog | Technisches SEO-Audit | Crawlt komplette Website, erkennt Duplicate Content, findet Redirect-Ketten |

| Ahrefs | Umfassende SEO-Analyse | Backlink-Analyse, Crawl-Budget-Schätzung, Duplicate-Content-Erkennung |

| Semrush | Wettbewerbsanalyse | Site-Audit-Funktionen, technische SEO-Probleme, Status der Seitenindexierung |

| Moz Pro | SEO-Toolset | Crawl-Diagnose, Duplicate-Content-Identifikation, Rank-Tracking |

Regelmäßige Website-Audits sind unerlässlich, um Shadow Pages zu identifizieren und zu entfernen, bevor sie Ihrer SEO-Leistung schaden. Die Google Search Console liefert die zuverlässigsten Daten darüber, welche Seiten von Google gefunden und indexiert wurden. Der Bericht zur Abdeckung zeigt ausgeschlossene Seiten und die Gründe für deren Ausschluss und hilft dabei, Shadow Pages zu identifizieren, die Suchmaschinen nicht indexieren. Im Bereich „Ausgeschlossen“ finden sich oft Shadow Pages, die durch URL-Parameter, Paginierung oder Redirect-Probleme entstehen.

Screaming Frog bietet einen umfassenden Crawl Ihrer gesamten Website und simuliert die Sichtweise von Suchmaschinen. Dieses Tool kann Duplicate Content, Redirect-Ketten, fehlende Canonical-Tags und andere technische Probleme aufdecken, die Shadow Pages erzeugen. Durch regelmäßige Screaming Frog-Audits können Sie Shadow Page-Probleme erkennen, bevor sie Ihre SEO-Leistung ernsthaft beeinträchtigen. Dank der Funktion zur Identifikation ähnlicher Inhalte lassen sich Duplikate konsolidieren und Ihre Seitenstruktur verbessern.

Die Umsetzung von Best Practices von Anfang an verhindert, dass Shadow Pages zum Problem werden. Verwenden Sie immer Canonical-Tags auf Seiten mit ähnlichem Inhalt, speziell auf E-Commerce-Seiten mit gefilterten Ergebnissen oder paginierten Inhalten. Achten Sie darauf, dass Ihre robots.txt-Datei nicht versehentlich wichtige Seiten blockiert, während Shadow Pages gecrawlt werden dürfen. Konfigurieren Sie Ihre sitemap.xml so, dass nur Seiten enthalten sind, die indexiert werden sollen – Shadow Pages und Seiten mit dünnem Inhalt bleiben außen vor.

Erarbeiten Sie klare Richtlinien für die URL-Struktur Ihres Entwicklerteams. Vermeiden Sie den Einsatz von Session-IDs, Tracking-Parametern oder Benutzerpräferenzen in URLs. Stattdessen sollten Sie diese Funktionen über Cookies oder serverseitige Sessions umsetzen, die keine neuen URLs generieren. Für dynamische Inhalte nutzen Sie URL-Rewriting, um saubere, konsistente URLs zu erzeugen, die Suchmaschinen leicht verstehen und indexieren können.

Setzen Sie stets 301-Redirects ein, wenn Sie URL-Strukturen ändern oder Seiten zusammenlegen. Überwachen Sie Redirect-Ketten, damit diese nicht mehr als drei Sprünge umfassen, denn zu viele Redirects verschwenden Crawl-Budget und können Indexierungsprobleme verursachen. Testen Sie alle Redirects regelmäßig, um sicherzustellen, dass sie korrekt funktionieren und auf die richtigen Zielseiten verweisen.

Shadow Pages stellen eine erhebliche SEO-Herausforderung dar, die die Sichtbarkeit Ihrer Website in Suchmaschinen und das Potenzial für organischen Traffic erheblich beeinträchtigen kann. Durch die Verschwendung des Crawl-Budgets, die Erzeugung von Duplicate Content und die Verwässerung von Link Equity verhindern Shadow Pages, dass Ihre wichtigsten Inhalte die Aufmerksamkeit der Suchmaschinen erhalten, die sie verdienen. Die gute Nachricht ist: Shadow Pages lassen sich durch eine korrekte Seitenarchitektur, Canonical-Tag-Implementierung und regelmäßige technische Audits weitgehend vermeiden.

Die Beseitigung von Shadow Pages sollte ein zentrales Anliegen Ihrer SEO-Strategie für 2025 sein. Beginnen Sie mit einem Audit Ihrer Website mithilfe von Google Search Console und Screaming Frog, um bestehende Shadow Pages zu identifizieren. Implementieren Sie Canonical-Tags auf doppelten Inhalten, verwenden Sie Noindex-Direktiven für nicht essentielle Seiten und restrukturieren Sie Ihre Seitenarchitektur, um die Entstehung neuer Shadow Pages zu verhindern. Wenn Sie dieses technische SEO-Problem angehen, verbessern Sie Ihre Crawl-Effizienz, bündeln Ihre Ranking-Power und erreichen letztlich eine bessere Sichtbarkeit und mehr organischen Traffic für Ihr Unternehmen.

Shadow Pages und technische SEO-Probleme können Ihre Performance im Affiliate-Marketing erheblich beeinträchtigen. PostAffiliatePro bietet umfassendes Tracking und Analysen, um SEO-Probleme zu erkennen und zu beheben, die die Sichtbarkeit und Conversions Ihres Affiliate-Programms beeinflussen. Überwachen Sie Ihre Affiliate-Seiten, verfolgen Sie Leistungskennzahlen und stellen Sie sicher, dass all Ihre Inhalte korrekt indexiert und optimiert sind.

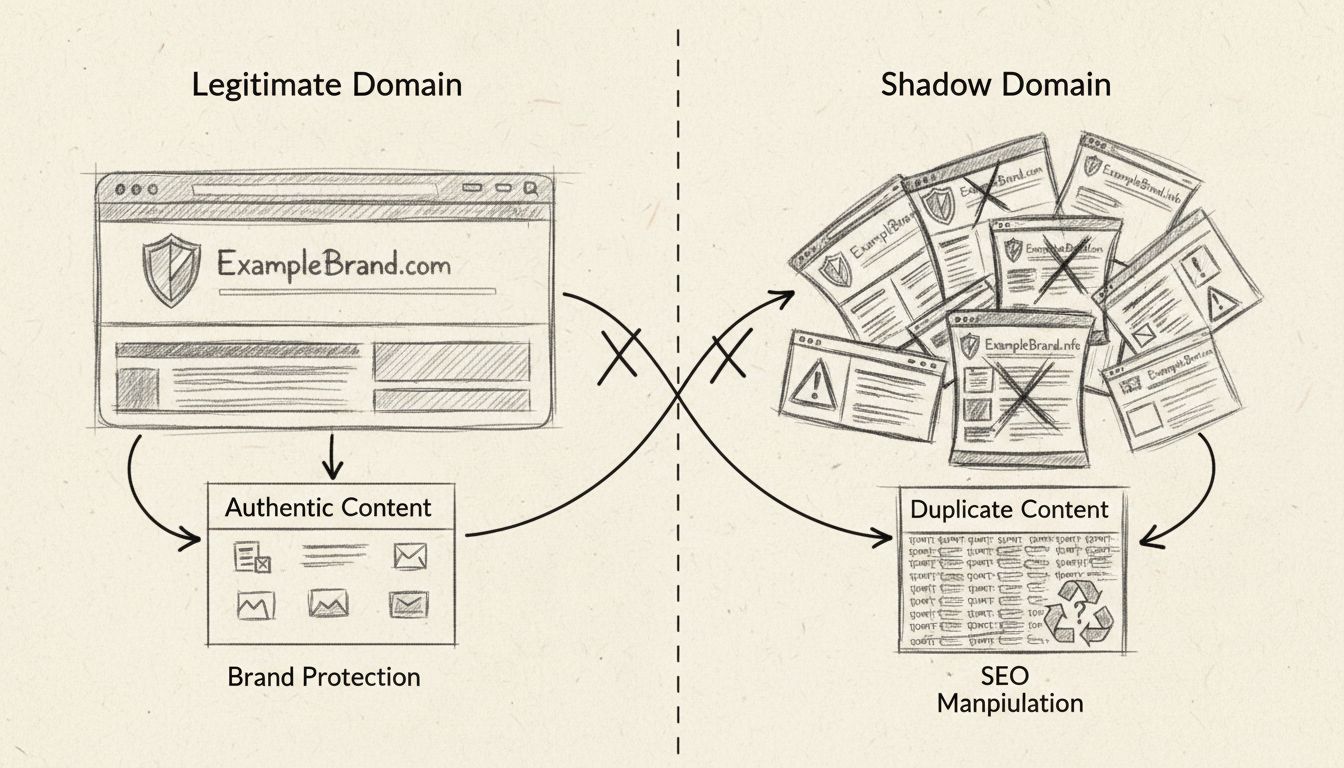

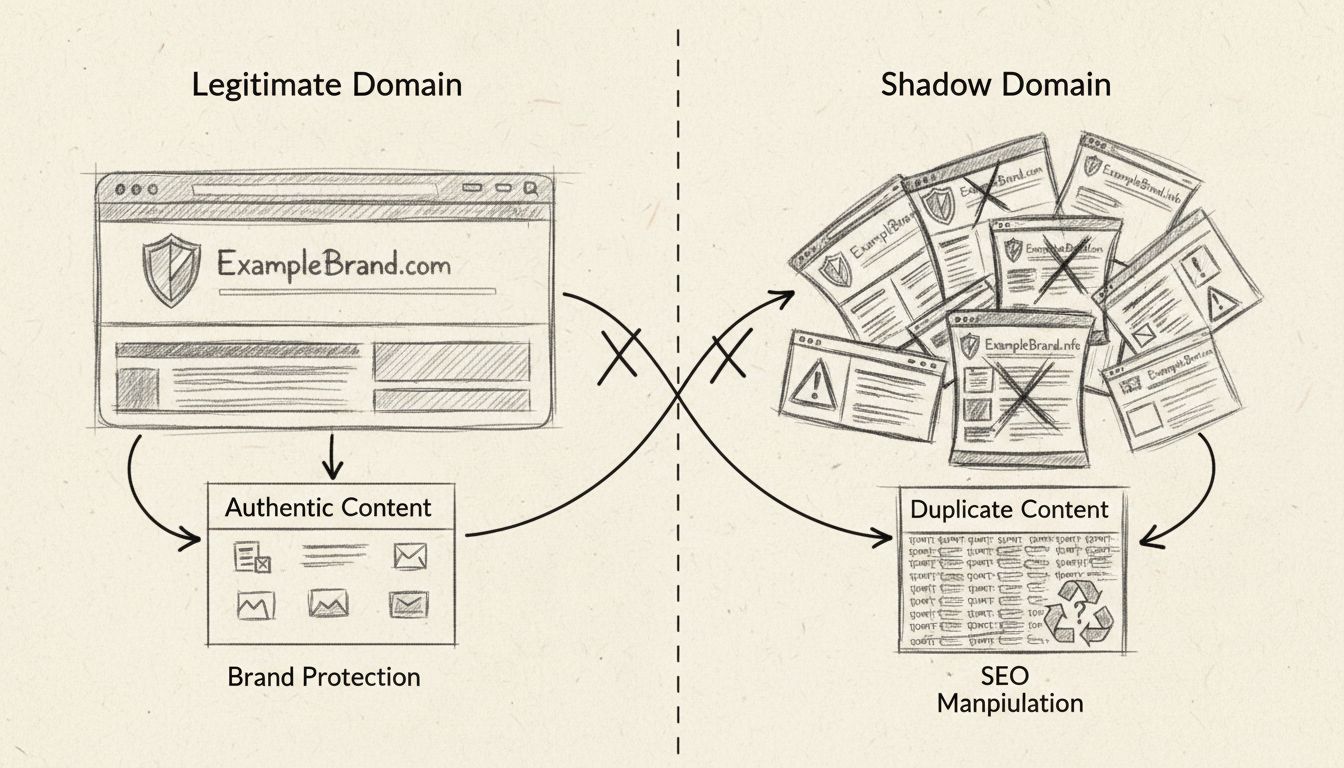

Erfahren Sie, warum Shadow Domains schädliche Black-Hat-SEO-Taktiken sind. Informieren Sie sich über Risiken wie Suchmaschinenstrafen, Traffic-Umleitung, Marken...

Shadow-Domains sind unautorisierte oder böswillige Domains, die legitime Websites imitieren, um Traffic umzuleiten, Suchmaschinenrankings zu manipulieren oder b...

Erfahren Sie, warum SEO-Cloaking Ihrer Website schadet. Entdecken Sie die Risiken von Black-Hat-SEO-Techniken, Google-Strafen und warum White-Hat-SEO-Strategien...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.