Sind LSI-Keywords für SEO im Jahr 2025 wichtig? Die

Erfahren Sie die Wahrheit über LSI-Keywords im Jahr 2025. Lernen Sie, warum Google keine LSI verwendet, was tatsächlich für SEO-Rankings zählt und wie Sie Inhal...

Erfahren Sie, ob Google LSI-Keywords nutzt, und lernen Sie, wie moderne semantische Suche tatsächlich funktioniert. Verstehen Sie BERT, RankBrain und entity-basierte Optimierung für bessere Rankings.

Nein, Google verwendet keine LSI-Keywords (Latent Semantic Indexing). John Mueller von Google hat mehrfach bestätigt, dass LSI eine veraltete Technologie aus den 1980er Jahren ist, die Google nie übernommen hat. Stattdessen nutzt Google fortschrittliche semantische Suchtechnologien wie BERT, RankBrain und Knowledge Graph, um den Bedeutungsgehalt und Kontext von Inhalten zu verstehen.

Der Begriff „LSI-Keywords“ hält sich seit über einem Jahrzehnt in SEO-Kreisen und sorgt für weitverbreitete Verwirrung darüber, wie Google Inhalte tatsächlich rankt. Viele Marketer glauben immer noch, dass das Einbauen von Listen semantisch verwandter Begriffe ein Rankingfaktor sei, obwohl Google diesen Ansatz lange aufgegeben hat, bevor der Begriff in der SEO-Community populär wurde. Den Unterschied zwischen der überholten LSI-Theorie und moderner semantischer Suche zu verstehen, ist entscheidend für alle, die Affiliate-Programme betreuen oder Inhalte erstellen, die 2025 gut ranken sollen.

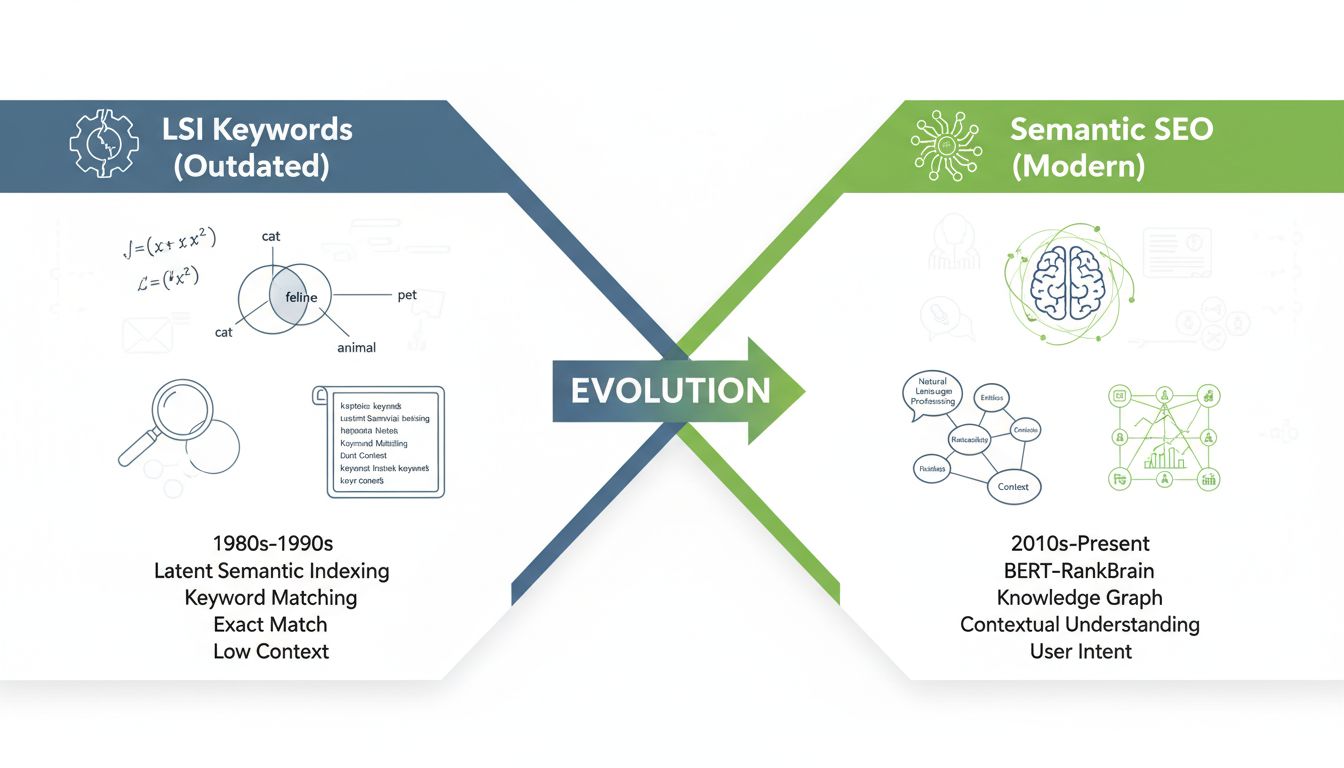

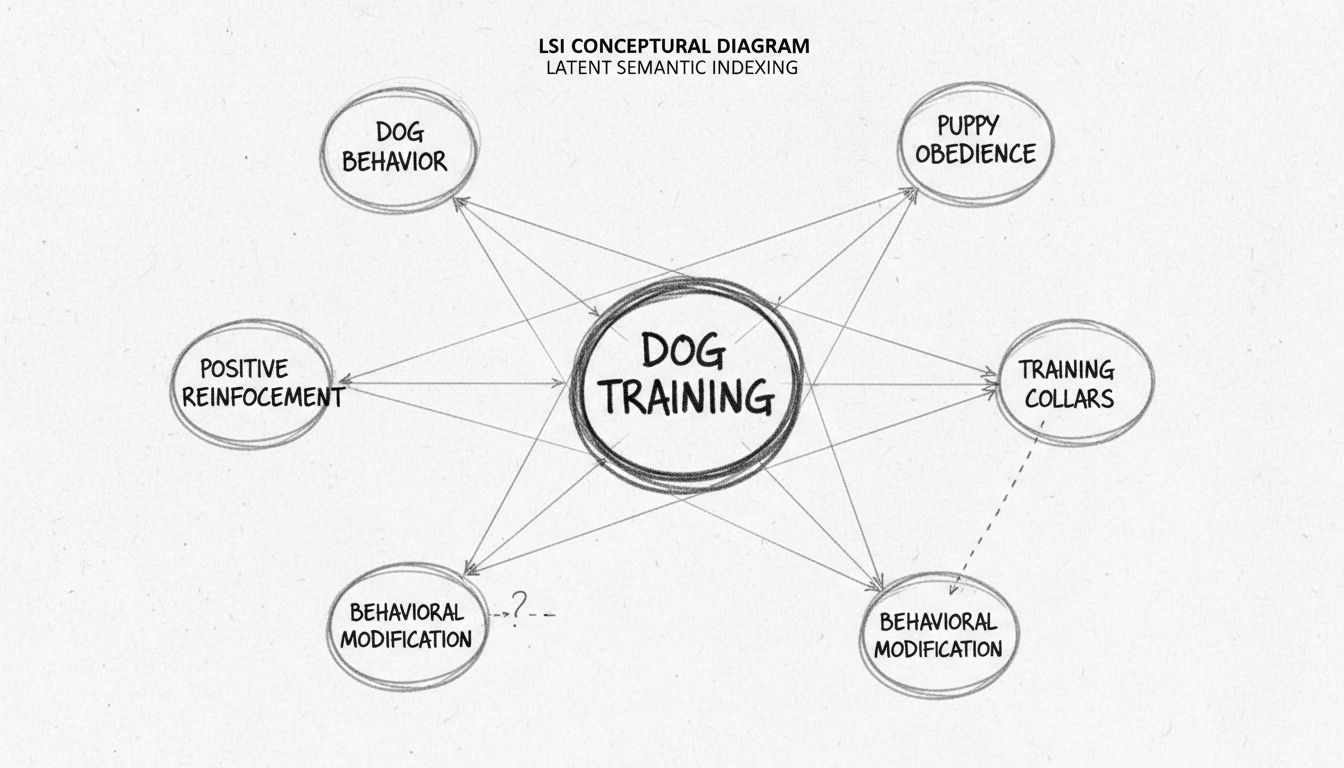

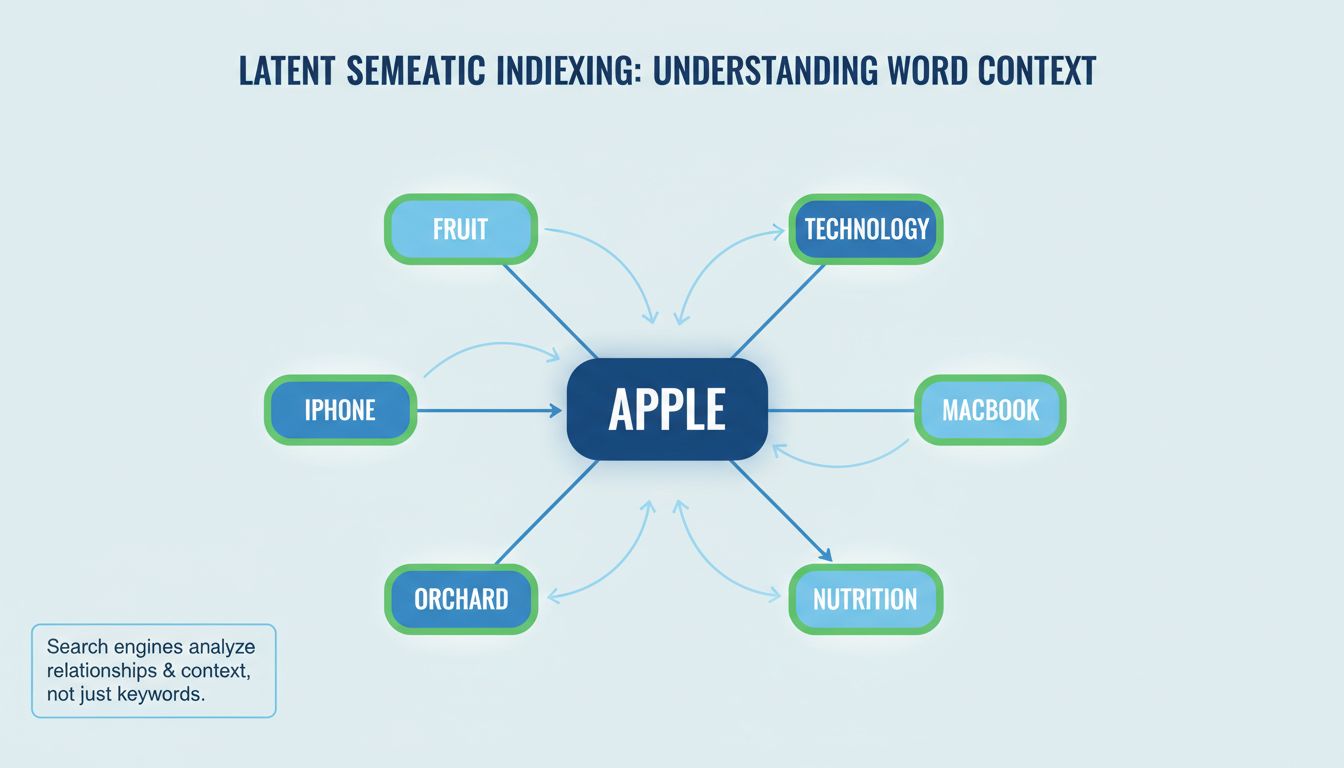

Latent Semantic Indexing war eine mathematische Methode, die in den späten 1980er Jahren entwickelt wurde, um Beziehungen zwischen Wörtern in Dokumentensammlungen zu analysieren. Das Verfahren nutzte Singulärwertzerlegung, um versteckte Muster im gemeinsamen Auftreten von Begriffen zu identifizieren, wodurch frühe Suchsysteme erkennen konnten, dass „Apple“ je nach Kontext entweder die Frucht oder das Technologieunternehmen meint. Obwohl dies damals innovativ war, war es nie für die Skalierung auf Milliarden von Webseiten ausgelegt, und Google hat ausdrücklich darauf verzichtet, es in ihren Ranking-Algorithmen zu implementieren.

Google hat sich weit über einfaches Keyword-Matching oder LSI-ähnliche Analysen hinaus entwickelt. Der Suchgigant setzt heute hochentwickelte Systeme zur Verarbeitung natürlicher Sprache ein, die Bedeutungen so verstehen, wie es mit 1980er-Technologie undenkbar gewesen wäre. Der wichtigste Durchbruch kam mit BERT (Bidirectional Encoder Representations from Transformers), das Google 2019 eingeführt hat. BERT analysiert Wörter im Kontext, indem es die Wörter davor und danach betrachtet und so Feinheiten wie Präpositionen und Zusätze versteht, die die Bedeutung komplett verändern können.

RankBrain, das 2015 eingeführte maschinelle Lernsystem von Google, interpretiert Suchanfragen und ordnet sie relevanten Inhalten anhand der Bedeutung und nicht aufgrund exakter Keyword-Übereinstimmungen zu. Dieses System lernt aus Milliarden von Suchen, um Muster zu erkennen, wie Menschen suchen und welche Inhalte ihre Bedürfnisse tatsächlich erfüllen. MUM (Multitask Unified Model), die jüngste Entwicklung von Google, erweitert diese Fähigkeit auf komplexe, mehrstufige Anfragen und sogar multimodale Eingaben, die Text und Bilder kombinieren.

Der Knowledge Graph ist ein weiterer zentraler Bestandteil des modernen semantischen Verständnisses. Diese riesige Datenbank kartiert Entitäten – Menschen, Orte, Produkte, Konzepte – und deren Beziehungen zueinander. Wenn Google eine Suchanfrage bearbeitet, sucht es nicht nur nach Seiten, die bestimmte Wörter enthalten; es identifiziert die involvierten Entitäten und findet Inhalte, die diese auf relevante Weise behandeln. Dieser entity-basierte Ansatz unterscheidet sich grundlegend von LSI, das sich auf Muster im gemeinsamen Auftreten von Begriffen konzentrierte, statt darauf, zu verstehen, was die Begriffe tatsächlich bedeuten.

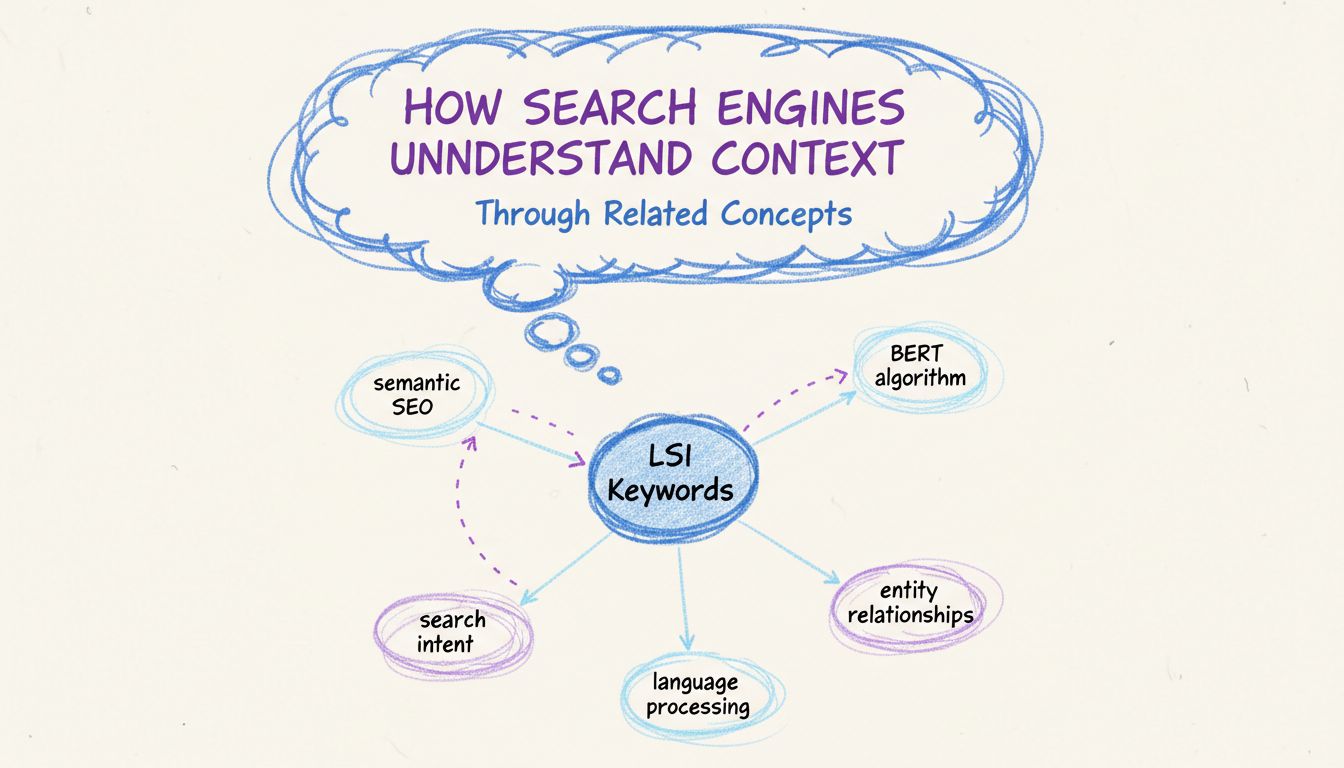

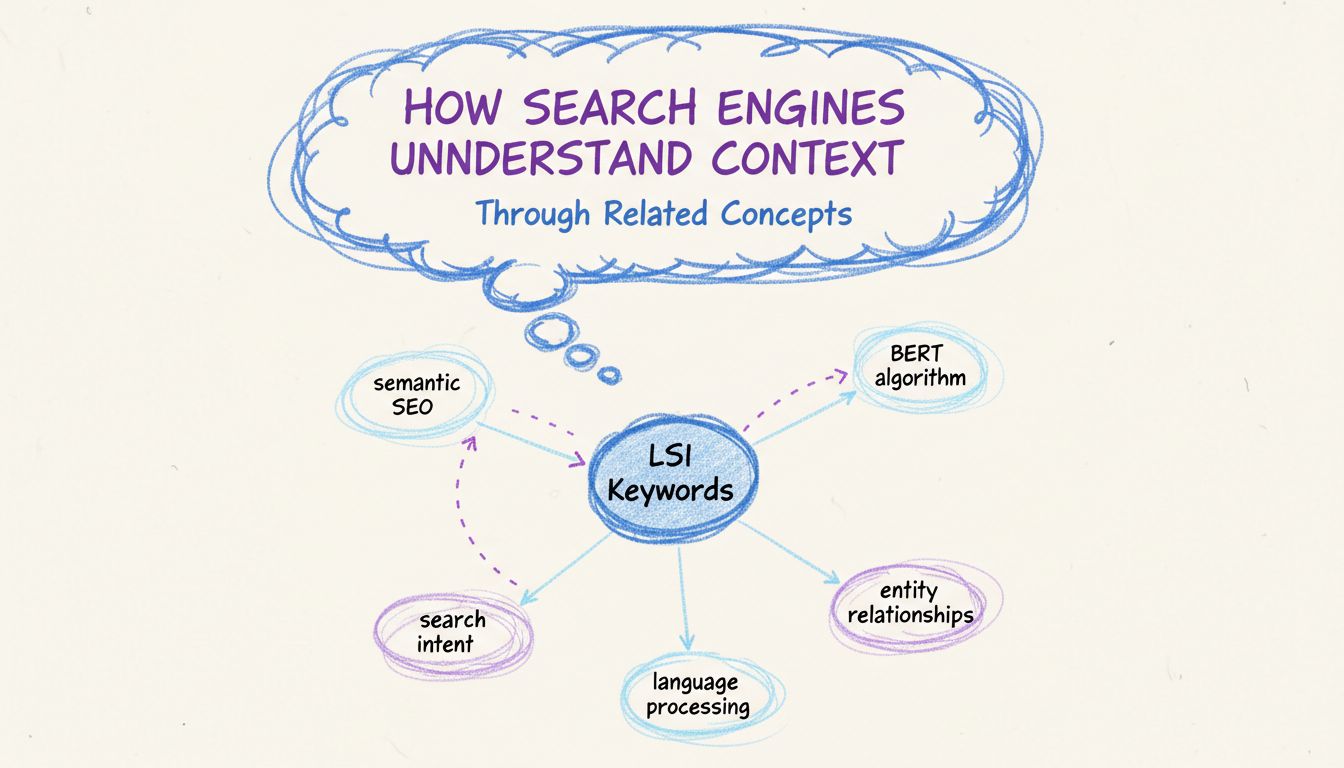

Viele Menschen verwenden die Begriffe „LSI-Keywords“ und „semantische Keywords“ synonym, doch diese Gleichsetzung verdeckt einen wichtigen Unterschied. LSI-Keywords beziehen sich auf einen spezifischen mathematischen Algorithmus, den Google nie in großem Maßstab eingesetzt hat. Semantische Keywords hingegen beschreiben Wörter und Phrasen, die kontextuell mit Ihrem Hauptthema verbunden sind und Suchmaschinen helfen, den vollen Umfang Ihres Inhalts zu erfassen. Die Verwirrung entstand, weil SEO-Tools eine Möglichkeit brauchten, verwandte Begriffe zu beschreiben, und „LSI-Keywords“ zu einer bequemen, wenn auch technisch ungenauen, Kurzform wurde.

Für die Content-Strategie ist dieser Unterschied von großer Bedeutung. Das Hinterherjagen von LSI-Keyword-Listen führt oft zu gezwungenem, unnatürlichen Schreiben, bei dem versucht wird, jeden vorgeschlagenen Begriff einzubauen, egal ob er sinnvoll ist oder nicht. Dieser Ansatz kann das Ranking sogar verschlechtern, weil moderne Suchmaschinen Inhalte abstrafen, die künstlich optimiert wirken oder keine echte Kohärenz besitzen. Semantisches SEO hingegen konzentriert sich darauf, das Thema wirklich zu verstehen und klar zu erklären, wodurch der thematische Wortschatz ganz natürlich einfließt – ein Signal für Suchmaschinen, das Expertise und Vollständigkeit zeigt.

| Aspekt | LSI-Keywords | Semantisches SEO |

|---|---|---|

| Verwendete Technologie | Mathematischer Algorithmus der 1980er | Moderne NLP, BERT, RankBrain, Knowledge Graph |

| Implementierung bei Google | Nie im großen Maßstab genutzt | Zentrales Rankingsystem |

| Optimierungsmethode | Einfügen von Keyword-Listen | Umfassende Themenabdeckung |

| Schreibqualität | Oft gezwungen und unnatürlich | Natürlich, leserorientiert |

| Ranking-Auswirkung | Keine (direkt) | Bedeutend (indirekt durch Klarheit) |

| Entity-Erkennung | Nicht anwendbar | Zentrale Bedeutung |

| Abgleich mit Nutzerintention | Eingeschränkt | Fortschrittliche Interpretation |

Wenn Google eine Webseite verarbeitet, zählt es nicht einfach die Häufigkeit von Keywords oder sucht nach vordefinierten Listen verwandter Begriffe. Stattdessen analysiert es die gesamte Seite, um zu verstehen, worum es tatsächlich geht, welche Entitäten behandelt werden und wie gut die Seite die Bedürfnisse der Nutzer erfüllt. Diese Interpretation erfolgt durch mehrere Analyseschichten, die zusammen ein umfassendes Verständnis des Inhalts ermöglichen.

Durch natürliche Sprachverarbeitung kann Google Satzstrukturen analysieren, grammatische Beziehungen erkennen und verstehen, wie Wörter sich gegenseitig modifizieren. Daher wird eine Seite über „Apfelkuchen-Rezepte“ anders verstanden als eine über „Apple Computerdetails“, obwohl beide das Wort „Apple“ enthalten. Der umgebende Kontext – Wörter wie „Rezept“, „Backen“, „Zutaten“ versus „Computer“, „Software“, „Prozessor“ – liefert die semantischen Signale, die diese Themen unterscheiden.

Entity Recognition geht noch einen Schritt weiter, indem es spezifische Dinge im Inhalt identifiziert. Liest Google etwa von „Steve Jobs“, sieht es nicht nur einen Namen, sondern erkennt darin eine bestimmte Person mit Eigenschaften, Beziehungen und historischer Bedeutung. Der Knowledge Graph verbindet diese Entität dann mit verwandten Konzepten wie Apple Inc., Innovation, Technologie und Unternehmertum. Dieses Beziehungsnetz hilft Google zu verstehen, worum es auf einer Seite geht und wie sie in den größeren Wissenskontext passt.

Googles Such-Advocates haben ihre Haltung zu LSI-Keywords wiederholt sehr deutlich gemacht. 2019 erklärte John Mueller, Googles Search Advocate, direkt auf Twitter: „Es gibt keine LSI-Keywords – wer etwas anderes behauptet, irrt sich, sorry.“ Dies war keine beiläufige Bemerkung, sondern eine gezielte Klarstellung, die einem hartnäckigen Missverständnis in der SEO-Branche begegnete. Mueller hat diese Position seither mehrfach wiederholt und klar gemacht, dass Googles Ranking-Systeme Latent Semantic Indexing in keiner Form verwenden.

Der Grund für diese Ablehnung ist einfach: LSI wurde für kleine, statische Dokumentensammlungen in kontrollierten Umgebungen entwickelt. Es war nie dafür gedacht, die Größenordnung, Vielfalt und Dynamik des modernen Webs zu bewältigen. Die Google-Gründer erkannten früh, dass LSI-ähnliche Ansätze nicht funktionieren würden, um Milliarden von Seiten zu unterschiedlichsten Themen und in verschiedensten Sprachen zu ranken. Stattdessen investierten sie in maschinelles Lernen, das aus echtem Nutzerverhalten lernt und sich kontinuierlich an neue Muster anpasst.

Darüber hinaus ist der mathematische Ansatz von LSI zur Erkennung semantischer Beziehungen im Vergleich zu dem, was neuronale Netze leisten können, sehr grob. Ein auf Milliarden von Dokumenten trainiertes neuronales Netz kann viel nuanciertere Beziehungen zwischen Konzepten lernen als ein mathematisches Modell, das lediglich das gemeinsame Auftreten von Begriffen analysiert. Darum sind BERT und ähnliche Systeme so viel effektiver im Verstehen von Sprachnuancen, Kontext und Bedeutung als jeder Algorithmus aus den 1980er Jahren.

Auch wenn LSI-Keywords selbst keine Rankings beeinflussen, so wirkt sich das zugrundeliegende Prinzip – dass Suchmaschinen Wert auf semantische Beziehungen und Kontext legen – sehr wohl auf die Platzierung von Seiten aus. Der Unterschied ist, dass modernes semantisches Verständnis deutlich ausgefeilter ist und auf einer tieferen Ebene arbeitet als simples Keyword-Matching oder die Analyse gemeinsamer Begriffsvorkommen. Wer Inhalte schreibt, die ein Thema umfassend behandeln und klar erklären, erzeugt ganz automatisch die semantischen Signale, die moderne Suchmaschinen erkennen und belohnen.

Umfassende Themenabdeckung ist eines der wichtigsten semantischen Signale. Wenn eine Seite ein Thema aus verschiedenen Blickwinkeln beleuchtet, unterstützende Konzepte einbezieht und Zusammenhänge erklärt, interpretieren Suchmaschinen dies als Zeichen von Expertise und Nützlichkeit. Darum ranken längere Inhalte oft besser als kurze – nicht weil die Länge selbst ein Rankingfaktor ist, sondern weil Tiefe eine vollständigere semantische Darstellung ermöglicht. Ein 500-Wörter-Artikel über „Kaffeezubereitungsarten“ erwähnt vielleicht Espresso, Pour Over und French Press, während ein 3.000-Wörter-Guide jede Methode im Detail erklärt, die Extraktionswissenschaft behandelt, Gerätewahl erläutert und häufige Fehler anspricht. Der längere Beitrag enthält ganz natürlich mehr semantische Signale, weil er das Thema umfassender abdeckt.

Klarheit bei Entitäten ist ein weiteres zentrales semantisches Signal. Wenn Sie die Entitäten, über die Sie schreiben, klar definieren und ihre Beziehungen erklären, helfen Sie Suchmaschinen, die Bedeutung Ihres Inhalts zu verstehen. Schreiben Sie etwa über Affiliate-Marketing-Software, so verschaffen Sie mit klaren Unterscheidungen zwischen verschiedenen Plattformen, der Erklärung ihrer Besonderheiten und der Darstellung der Beziehung zu verschiedenen Geschäftsmodellen eine semantische Klarheit, die Google hilft, den Umfang und die Relevanz Ihres Inhalts zu erkennen.

Zu wissen, dass Google keine LSI-Keywords verwendet, aber sehr wohl Wert auf semantische Bedeutung legt, sollte die Herangehensweise an Content-Erstellung grundlegend verändern. Suchen Sie nicht nach LSI-Keyword-Listen und versuchen Sie nicht, diese zwanghaft einzubauen. Konzentrieren Sie sich stattdessen darauf, Ihr Thema tiefgehend zu verstehen und verständlich zu erklären. Das führt gleichzeitig zu besseren Inhalten für Leser und stärkeren Signalen für Suchmaschinen.

Recherchieren Sie zunächst, welche Fragen Ihr Publikum zu Ihrem Thema tatsächlich stellt. Nutzen Sie Googles „Nutzer fragen auch“-Abschnitt, Autovervollständigung und Tools wie AnswerThePublic, um das gesamte Spektrum der Nutzerintention zu erfassen. Diese Quellen zeigen Ihnen die semantischen Beziehungen, die für echte Suchende relevant sind – nicht theoretische Keyword-Listen. Wenn Sie Ihren Content so strukturieren, dass Sie diese Fragen umfassend beantworten, bauen Sie ganz natürlich den Wortschatz und die Konzepte ein, die Suchmaschinen als relevant erkennen.

Studieren Sie die Top-Ranking-Seiten zu Ihren Ziel-Keywords, aber analysieren Sie sie nicht, um LSI-Keyword-Listen zu extrahieren. Untersuchen Sie stattdessen, wie sie Informationen strukturieren, welche Subthemen sie behandeln, welche Entitäten sie diskutieren und wie sie Beziehungen zwischen Konzepten erklären. Diese Analyse zeigt Ihnen den semantischen Umfang, den Google für Ihr Thema erwartet. Wenn jede Top-Seite „Affiliate-Provisionsmodelle“, „Zahlungsabwicklung“ und „Betrugsprävention“ neben Ihrem Hauptthema behandelt, sind das keine LSI-Keywords, die Sie zwanghaft einbauen müssen – es sind essentielle Bestandteile einer umfassenden Behandlung, die Sie natürlich adressieren sollten.

Trotz jahrelanger Klarstellungen durch Google halten sich mehrere Mythen rund um LSI hartnäckig in SEO-Communities und Trainingsmaterialien. Ein weitverbreitetes Missverständnis ist, dass LSI-Keyword-Tools besondere Einblicke in das Google-Ranking liefern. Tatsächlich zeigen diese Tools lediglich verwandte Suchbegriffe und Synonyme – Informationen, die Sie auch kostenlos über Googles eigene Suchfunktionen erhalten. Die „LSI“-Bezeichnung ist reines Marketing; die Tools führen keine Latent Semantic Indexing-Analyse durch.

Ein weiterer häufiger Mythos besagt, dass Sie eine bestimmte Anzahl oder einen bestimmten Prozentsatz von LSI-Keywords einbauen müssten, um optimal zu ranken. Diese Vorstellung führt zu formelhaftem, unnatürlichem Schreiben, das die Content-Qualität sogar verschlechtern kann. Moderne Suchmaschinen bewerten Inhalte ganzheitlich und nicht anhand abgehakter Keyword-Vorgaben. Eine Seite, die relevante Konzepte natürlich einbindet und dabei eine exzellente Lesbarkeit und Nutzererfahrung bietet, wird eine Seite mit mehr künstlich eingestreuten Keywords, aber schlechter Lesbarkeit, übertreffen.

Einige Marketer glauben immer noch, dass LSI-Keywords dünne oder minderwertige Inhalte ausgleichen könnten. Das ist grundsätzlich falsch. Das Hinzufügen verwandter Begriffe zu oberflächlichem Content macht diesen nicht umfassender oder autoritativer. Suchmaschinen bewerten die tatsächliche Tiefe der Erklärung, die Informationsqualität und ob der Inhalt die Nutzerbedürfnisse wirklich adressiert. Keine Menge an Keyword-Variationen kann echte Expertise und gründliche Abdeckung ersetzen.

Anstatt veralteten SEO-Mythen nachzujagen, brauchen erfolgreiche Affiliate-Programm-Manager Tools, die ihnen zeigen, was tatsächlich zu Conversions und Engagement führt. PostAffiliatePro bietet umfassende Analysen und Tracking, die Ihnen genau zeigen, welche Content-Strategien, Affiliate-Partner und Marketingansätze echte Ergebnisse bringen. Anstatt zu raten, ob Ihre semantische Optimierung funktioniert, sehen Sie konkrete Daten zu Traffic-Quellen, Konversionsraten und Umsatzzuordnung.

Die fortschrittlichen Reporting-Funktionen von PostAffiliatePro helfen Ihnen, die Verbindung zwischen Ihrer Content-Strategie und konkreten Geschäftsergebnissen zu verstehen. Sie können nachvollziehen, welche Seiten den qualifiziertesten Traffic bringen, welche Affiliate-Partner die wertvollsten Abschlüsse erzielen und wie unterschiedliche Content-Ansätze sich auf Ihr Geschäftsergebnis auswirken. Dieser datengetriebene Ansatz ist deutlich effektiver als allgemeine SEO-Empfehlungen, da er auf Ihr spezifisches Publikum, Ihren Markt und Ihr Geschäftsmodell zugeschnitten ist.

Das Echtzeit-Tracking und die detaillierten Analysen der Plattform helfen Ihnen außerdem, Optimierungspotenziale zu erkennen, die generische SEO-Tools oft übersehen. Sie sehen genau, wie Nutzer mit Ihren Inhalten interagieren, wo sie abspringen und welche Botschaften besonders gut ankommen. Diese Einblicke erlauben es Ihnen, Ihre Content-Strategie auf Basis realer Nutzerverhaltensdaten und nicht bloß theoretischer Best Practices zu optimieren.

Die Hartnäckigkeit von LSI-Keyword-Diskussionen im Jahr 2025 zeigt eine Kluft zwischen veralteter SEO-Theorie und der Realität moderner Suche. Google hat wiederholt und eindeutig klargestellt: LSI-Keywords sind kein Bestandteil des Ranking-Systems. Was stattdessen zählt, ist das semantische Verständnis – die Fähigkeit der Suchmaschinen, zu begreifen, worum es in Ihren Inhalten wirklich geht, welche Entitäten behandelt werden und wie gut die Bedürfnisse der Nutzer adressiert werden.

Für Affiliate-Marketer und Content-Ersteller sollte diese Klarheit befreiend wirken. Anstatt Zeit mit der Recherche von LSI-Keyword-Listen zu verbringen und diese zwanghaft einzubauen, investieren Sie diese Energie lieber in ein tiefes Verständnis Ihres Themas und eine klare Erklärung. Schreiben Sie zuerst für Ihr Publikum, optimieren Sie anschließend für Suchmaschinen und vertrauen Sie darauf, dass umfassend strukturierte Inhalte von modernen Suchmaschinen automatisch mit den richtigen semantischen Signalen erkannt und belohnt werden.

Die Zukunft von SEO besteht nicht aus Keyword-Tricks oder mechanischer Optimierung – sie besteht darin, wirklich nützliche Inhalte zu schaffen, die Expertise demonstrieren und echte Nutzerbedürfnisse adressieren. Wenn Sie auf semantische Klarheit, umfassende Themenabdeckung und entity-basiertes Verständnis setzen, erstellen Sie Inhalte, die nicht nur im klassischen Google-Ranking, sondern auch in KI-generierten Antworten und aufkommenden Suchplattformen herausragen. Das ist der echte Wettbewerbsvorteil im Jahr 2025 und darüber hinaus.

Hören Sie auf zu raten, was SEO betrifft, und beginnen Sie damit, nachzuverfolgen, was tatsächlich funktioniert. Die fortschrittlichen Analysen von PostAffiliatePro helfen Ihnen zu verstehen, welche Content-Strategien echte Affiliate-Conversions erzeugen. Erhalten Sie die Einblicke, die Sie benötigen, um ein profitables Affiliate-Programm aufzubauen.

Erfahren Sie die Wahrheit über LSI-Keywords im Jahr 2025. Lernen Sie, warum Google keine LSI verwendet, was tatsächlich für SEO-Rankings zählt und wie Sie Inhal...

Erfahren Sie, wie Latent Semantic Indexing (LSI) die Kontextrelevanz Ihrer Inhalte erhöht, das Suchmaschinen-Ranking verbessert und mehr organischen Traffic zu ...

Erfahren Sie, wie Latent Semantic Indexing das SEO im Jahr 2025 beeinflusst. Entdecken Sie, wie LSI-Schlüsselwörter das Suchranking, die Inhaltsrelevanz und den...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.